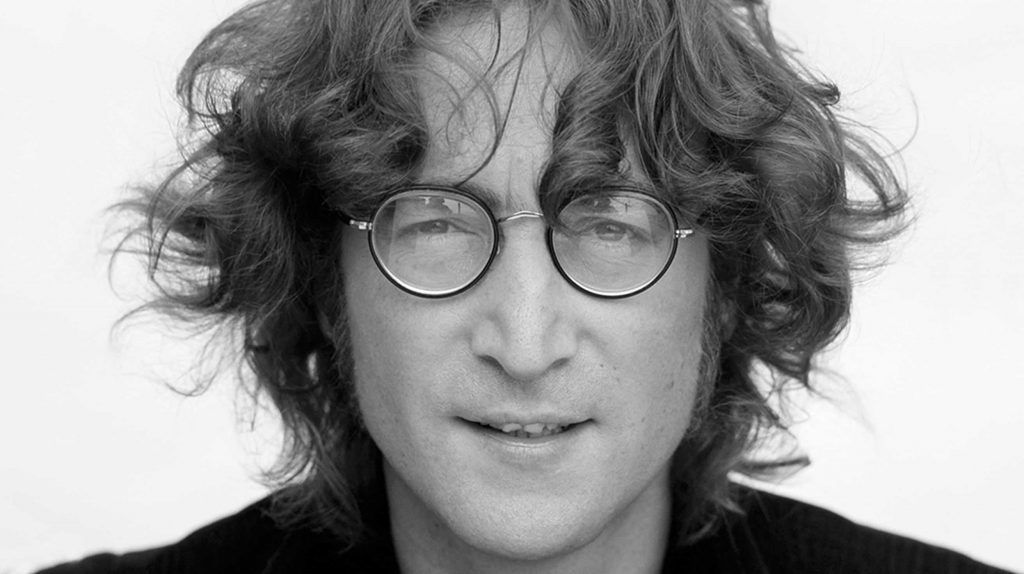

John Lennon. Foto: Reprodução

John Lennon. Foto: ReproduçãoEntenda como funciona a tecnologia que permitiu “ressuscitar” John Lennon na nova música dos Beatles

Novas aplicações permitem que vozes sejam extraídas de uma música pré-gravada, além de criar linhas vocais baseadas em dados do passado

Direto de Utah, nos Estados Unidos, o recifense Geraldo Ramos — 38 anos, CEO da empresa de tecnologia musical Moises — me mostra uma tela com arquivos de vocais de alguns “cantores fantasmas”, disponíveis na plataforma Voice Studio. Profissionais, contratados pela empresa, venderam 20 horas de gravações de suas vozes para serem disponibilizadas no banco de dados da aplicação.

Um produtor de estúdio, com uma música pronta, barbudo e careca, pega o microfone e grava, de forma amadora e cheia de defeitos, uma linha vocal para a música. Então, ele acessa a aplicação, escolhe a voz da cantora Kate (um avatar, criado pela Moises), aperta um botão e — bingo! — a voz do produtor é substituída pela da cantora virtual na música, em uma performance primorosa.

Sim, é isso mesmo o que você está pensando: qualquer voz pode ser clonada, e de uma hora para outra, um cantor sem talento e desafinado como, por exemplo, o jornalista Jota Wagner, pode aparecer por aí cantando com a voz do Elvis Presley. Mas como funciona?

– A substituição é feita em cima de um modelo de voz. Artistas já estão criando bancos dados da própria voz. Isso permite que, por exemplo, nos estúdios, bandas e produtores possam fazer gravações de testes sem que o cantor esteja presente – nos conta Ramos.

Algoritmos permitem que uma interpretação, com suas notas, expressões e nuances, sejam aplicadas ao banco de dados pré-existente. Mas como fazer isso, por exemplo, com artistas já falecidos, como vimos em Now And Then, a última música dos Beatles, que “ressuscitou” John Lennon?

O processo acontece em duas etapas. Na primeira, softwares como o pioneiro Moises “extraem” uma voz ou instrumento de uma música previamente gravada. Explicamos.

Cada tipo de som gera uma frequência de onda que é medida em Hertz, que vai do grave ao agudo. Um contrabaixo, por exemplo, passeia em um “espaço” entre 20 Hertz e 200 Hertz. Já a guitarra, que é mais aguda, pode chegar a até 630 Hertz, aproximadamente.

Isso significa que, se olharmos em um gráfico, os dois instrumentos estão em pontos diferentes de um arquivo de áudio, permitindo que o software extraia esta frequência e gere um novo arquivo somente com a guitarra, o baixo ou… a voz!

Porém, a extração nem sempre sai perfeita. Afinal, em uma música já pronta, mais de um instrumento pode estar soando na mesma frequência. A partir daí, usando as novas tecnologias, chamadas de Inteligência Artificial ou Machine Learning, é possível fazer uma regeneração do banco de dados da voz usando outros arquivos disponíveis, do mesmo artista.

As aplicações procuram outras fontes disponíveis no mundo digital e aplicam no arquivo extraído os fragmentos que faltam, tornando-os prontos para serem usados novamente, em uma música inédita. Mais ou menos, é como restaurar uma pintura antiga, desgastada pelo tempo.

No caso dos Beatles, a voz de John Lennon cantando Now And Then estava gravada em uma fita de 1979, que a banda não conseguiu usar nos anos 90, quando lançou as outras duas músicas após a morte do vocalista — Free As A Bird e Real Love. Neste caso, havia muito ruído e, principalmente, o piano se sobrepunha à voz de John.

Como conta o minidoc lançado junto com “a última música dos Beatles” (veja no player acima), no último dia 02, foi só a partir de uma tecnologia de Machine Learning, desenvolvida pelo diretor de cinema Peter Jackson e sua equipe, que foi possível “limpar” a voz de Lennon para ser usada na nova gravação.

Criando versos do zero (e de forma acessível)

Mas a tecnologia permite ir além. Com as vozes regeneradas, é possível criar uma base para interpretações que ainda não existem — como a “collab” fake entre Drake e The Weeknd, Heart On My Sleeve, criada do zero pelo tiktoker Ghostwriter977, através de inteligência artificial.

O mais louco é que isso pode ser feito por qualquer produtor musical, até mesmo em sua casa. As assinaturas das aplicações do Moises variam entre $ 4 a $ 24 dólares mensais. Não precisa nem ter um computador superpotente no estúdio. A parte pesada do processamento é baseada na nuvem, ou seja, administrada pelos computadores da empresa.

O aplicativo não está sozinho no mercado. Apesar de pioneiro, ele já tem alguns concorrentes, como Melody e Audiostrip, entre outros.

https://www.youtube.com/watch?v=7HZ2ie2ErFI

Não é preciso ser um gênio da produção musical para imaginar tudo o que essas novas ferramentas podem trazer à música em um futuro próximo. Músicos poderão, por exemplo, deixar um banco de dados de suas vozes disponíveis, para o dia em que não estiverem mais vivos.

Casos como os exemplos citados acima se multiplicarão e, mais do que isso, serão oficiais, autorizados pelos próprios artistas, em vida, aos detentores de seus direitos póstumos.

E não para por aí.

– A produção musical vai ficar cada vez mais acessível. Antigamente, era preciso ter um estúdio profissional, com equipamentos caríssimos. Hoje, a pessoa pode gravar no microfone do seu celular e pode substituir a voz por uma base pré-gravada, usando compressores e microfones de última geração. Este gap entre o amador e o profissional está diminuindo, cada vez mais. Com muito menos recursos, os resultados são muito mais impressionantes.

Geraldo Ramos ao Music Non Stop.